在爬取网页信息时,需要注意网页爬虫规范文件robots.txt

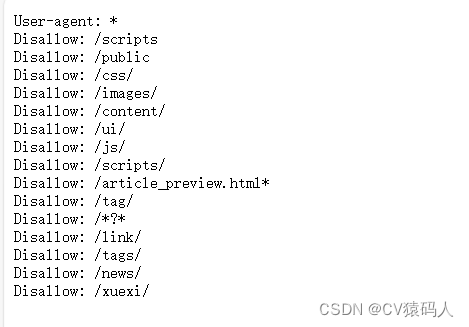

eg:csdn的爬虫规范文件 csdn.net/robots.txt

User-agent:

下面的Disallow规则适用于所有爬虫(即所有用户代理)。星号*是一个通配符,表示“所有”。

Disallow:

禁止爬虫访问的路径

1、首先下载python的相关类库

pip install requests

pip install beautifulsoup4requests 是一个http库,可以发送网络请求 。

beautifulsoup4 主要用来解析html文档。

2、引入相关库

import requests

from bs4 import BeautifulSoup 3、编写相关代码

url = 'https://www.....com'

response = requests.get(url)

html_content = response.text

soup = BeautifulSoup(html_content, 'html.parser')

titles = soup.select('h2')

for title in titles:

print(title.text)url : 需要爬的页面路径

response = requests.get(url) 发送get请求并接受

html_content = response.text 取出页面主体

soup = BeautifulSoup(html_content, 'html.parser') 由beautifulsoup对主体中的h5标签解析

titles = soup.select('h2') 选择所有的h2标签

最后循环遍历打印出所有h2 标签

4、测试