温馨提示:要看高清无码套图,请使用手机打开并单击图片放大查看。

Fayson的github:

https://github.com/fayson/cdhproject

提示:代码块部分可以左右滑动查看噢

1.文档编写目的

前面的文章《如何在CDH集群外配置Kerberos环境的GateWay节点》和《如何在CDH集群外配置非Kerberos环境的GateWay节点》中Fayson介绍了在不将集群外节点添加到CM管理中实现各组件客户端访问CDH集群功能,本篇文章Fayson主要在前文章实现的基础上配置Spark2和Kafka客户端环境。

- 内容概述:

1.部署环境说明

2.部署Spark2和Kafka环境及测试

3.总结

- 测试环境:

1.CM和CDH版本为5.14.2

2.操作系统为RedHat7.3

3.操作用户root

- 测试环境:

1.Gateway节点与集群网络正常

2.环境说明

集群外节点:

IP地址 | HostName | 操作系统 |

172.27.0.5 | cdh05.fayson.com | RedHat7.3 |

集群环境:

IP地址 | HostName | 操作系统 |

172.27.0.4 | cdh01.fayson.com | RedHat7.3 |

172.27.0.11 | cdh02.fayson.com | RedHat7.3 |

172.27.0.7 | cdh03.fayson.com | RedHat7.3 |

172.27.0.3 | cdh04.fayson.com | RedHat7.3 |

cdh05.fayson.com节点并未添加到CM中:

3.部署Spark2及Kafka客户端环境

1.将集群的hosts文件同步至该Gateway节点(cdh05.fayson.com)

[root@cdh01 ~]# scp /etc/hosts cdh05.fayson.com:/etc/

(可左右滑动)

2.登录集群任意节点,将集群的Java目录拷贝至(cdh05.fayson.com)节点的/usr/java目录下

[root@cdh01 conf]# scp -r /usr/java/jdk1.8.0_131/ cdh05.fayson.com:/usr/java/

(可左右滑动)

注意:Java的HOME目录与集群部署的一致。

3.登录CDH集群的任意节点,将/opt/cloudera/parcels目录下的SPARK2和KAFKA目录压缩并拷贝至(cdh05.fayson.com)节点

[root@cdh01 ~]# cd /opt/cloudera/parcels/

[root@cdh01 parcels]# tar -czvf SPARK2-2.2.0.cloudera2-1.cdh5.12.0.p0.232957.tar.gz SPARK2-2.2.0.cloudera2-1.cdh5.12.0.p0.232957

[root@cdh01 parcels]# tar -czvf KAFKA-2.2.0-1.2.2.0.p0.68.tar.gz KAFKA-2.2.0-1.2.2.0.p0.68/

(可左右滑动)

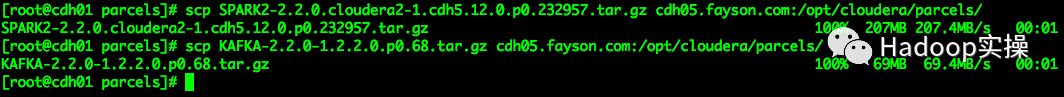

将Spark2和Kafka的压缩包拷贝至cdh05.fayosn.com服务器的/opt/cloudera/parcels目录下:

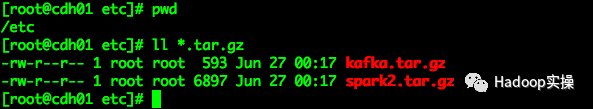

将/etc目录下spark2和kafka目录压缩

[root@cdh01 etc]# cd /etc/

[root@cdh01 etc]# tar -czvf spark2.tar.gz spark2

[root@cdh01 etc]# tar -czvf kafka.tar.gz kafka/

(可左右滑动)

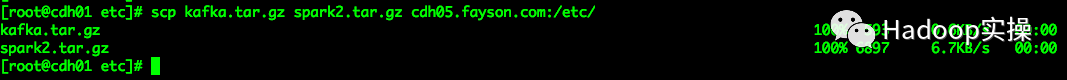

将spark2.tar.gz和kafka.tar.gz压缩包拷贝至cdh05.fayosn.com的/etc目录下

4.登录(cdh05.fayson.com)节点的服务器上,进入/opt/cloudera/parcels目录,并将压缩包解压至该目录下

[root@cdh05 ~]# cd /opt/cloudera/parcels/

[root@cdh05 parcels]# tar -zxvf SPARK2-2.2.0.cloudera2-1.cdh5.12.0.p0.232957.tar.gz

[root@cdh05 parcels]# tar -zxvf KAFKA-2.2.0-1.2.2.0.p0.68.tar.gz

(可左右滑动)

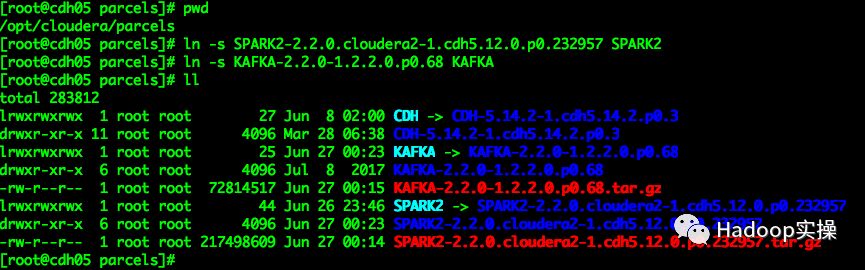

为解压出来的SPARK2和KAFKA目录创建软连

[root@cdh05 parcels]# pwd

[root@cdh05 parcels]# ln -s SPARK2-2.2.0.cloudera2-1.cdh5.12.0.p0.232957 SPARK2

[root@cdh05 parcels]# ln -s KAFKA-2.2.0-1.2.2.0.p0.68 KAFKA

(可左右滑动)

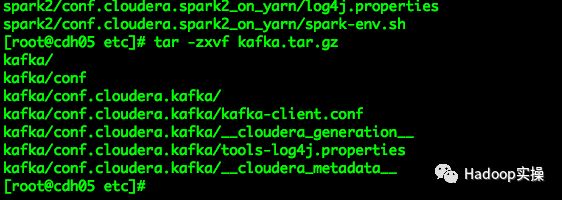

进入到/etc目录下,将spark2.tar.gz和kafka.tar.gz压缩包解压至当前目录

[root@cdh05 parcels]# cd /etc/

[root@cdh05 etc]# tar -zxvf spark2.tar.gz

[root@cdh05 etc]# tar -zxvf kafka.tar.gz

(可左右滑动)

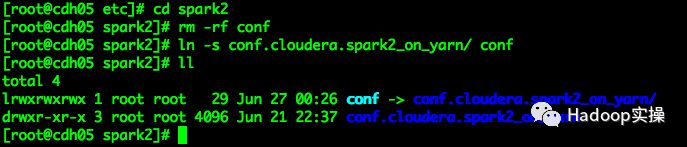

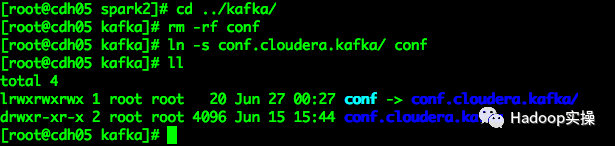

分别进入kafka和spark2目录下删除相应的软连接,重新创建新的软连

[root@cdh05 etc]# cd spark2

[root@cdh05 spark2]# rm -rf conf

[root@cdh05 spark2]# ln -s conf.cloudera.spark2_on_yarn/ conf

[root@cdh05 spark2]# ll

(可左右滑动)

[root@cdh05 spark2]# cd ../kafka/

[root@cdh05 kafka]# rm -rf conf

[root@cdh05 kafka]# ln -s conf.cloudera.kafka/ conf

(可左右滑动)

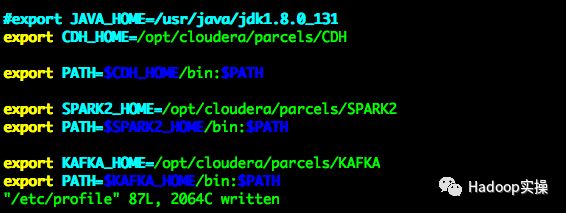

5.在cdh05.fayson.com节点配置Spark2和Kafka的环境变量

修改/etc/profile配置文件,在文件的末尾增加如下配置:

export SPARK2_HOME=/opt/cloudera/parcels/SPARK2

export PATH=$SPARK2_HOME/bin:$PATH

export KAFKA_HOME=/opt/cloudera/parcels/KAFKA

export PATH=$KAFKA_HOME/bin:$PATH

(可左右滑动)

修改后执行如下命令是环境变量生效:

[root@cdh05 ~]# source /etc/profile

4.Spark2和Kafka客户端命令验证

1.执行Spark2-shell命令

spark2-shell命令执行成功,通过CM查看Yarn作业

2.使用spark2-submit命令向集群提交一个spark作业

spark2-submit --class org.apache.spark.examples.SparkPi \

--master yarn-client --num-executors 4 --driver-memory 2g \

--driver-cores 1 --executor-memory 2g --executor-cores 1 \

/opt/cloudera/parcels/SPARK2/lib/spark2/examples/jars/spark-examples_2.11-2.2.0.cloudera2.jar 10

(可左右滑动)

通过Yarn界面查看,作业执行成功

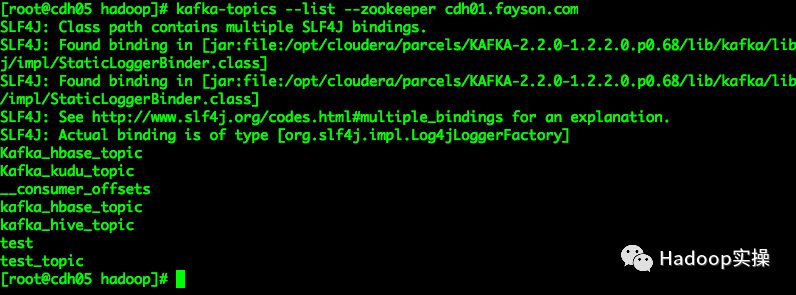

3.测试Kafka命令,列出Kafka的所有topic

[root@cdh05 hadoop]# kafka-topics --list --zookeeper cdh01.fayson.com

(可左右滑动)

命令执行成功。

5.总结

1.本篇文章在前面的文章基础上进行配置,如果未配置Hadoop等相关服务的Gateway则会导致Spark2无法加载Hadoop的依赖包等异常。

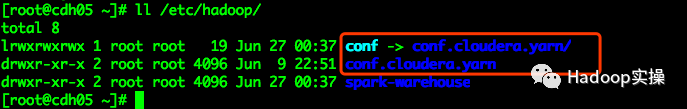

2.在使用Spark2-submit提交Spark作业时遇到“Exception running /etc/hadoop/conf.cloudera.yarn/topology.py”异常,由于前面的文章Fayson是直接将Hadoop的相关配置拷贝至/etc/hadoop/conf目录下,需要将与集群的目录配置一致,如下截图:

为避免其他服务也出现该异常,也以同样的方式配置。

提示:代码块部分可以左右滑动查看噢

为天地立心,为生民立命,为往圣继绝学,为万世开太平。

温馨提示:要看高清无码套图,请使用手机打开并单击图片放大查看。

推荐关注Hadoop实操,第一时间,分享更多Hadoop干货,欢迎转发和分享。

原创文章,欢迎转载,转载请注明:转载自微信公众号Hadoop实操